A inteligência artificial (IA) chegou aos tribunais brasileiros não como uma revolução silenciosa, mas por meio de uma série de casos emblemáticos que expuseram tanto o potencial quanto os perigos dessa tecnologia na prática jurídica. Desde o primeiro caso documentado no Tribunal Superior Eleitoral (TSE), em 2023, até as recentes sanções aplicadas em Rondônia e no Tribunal Regional Federal da 4ª Região (TRF4), em 2025, o Poder Judiciário brasileiro tem enfrentado um dilema complexo: como equilibrar a inovação tecnológica com a integridade do sistema de justiça.

Elas (as ferramentas de IAs) estão presentes na construção deste texto. Manus Ia e Elicit colaboraram na pesquisa de fontes e marcos comparados. Clarice.ia, revisora atenta, cuidou da ortografia e da fluidez. E ChatGPT? Atuou como antítese — espelho crítico da tese aqui defendida. O que se lê, portanto, é também um experimento: a autora escrevendo sobre a máquina com a ajuda da própria máquina. E é nesse paradoxo que mora a urgência da ética.

Ela começou tímida, assistente de escrita, copiloto de pesquisas. Hoje, fala latim, cita doutrina, busca precedentes e tenta ser “curiae”, mesmo sem ter parte. Ela — a Inteligência Artificial — já atravessou os corredores do Judiciário brasileiro, não como espectadora silenciosa, mas como voz ativa, ainda que sintética, nos autos. E, com ela, vieram as infrações, as sanções, os silêncios cúmplices e os alertas regulatórios.

Entre 2023 e 2025, vimos tribunais punirem advogados que recorreram à IA sem freios, entregando petições moldadas por softwares generativos que mais alucinam do que fundamentam. Em meio a esse cenário, a OAB não vestiu a toga da censura. Preferiu o manto mais complexo da regulação. Não proibiu, mas orientou. E essa escolha não é neutra: ela reflete uma aposta — talvez a última — na ética como tecnologia fundacional do Direito.

Neste ensaio, olhamos para Ela — a IA — com olhos não apenas jurídicos, mas humanos. Acompanhamos sua entrada nos autos e na rotina forense, com os olhos de quem vê o futuro tentando redigir a petição inicial da advocacia do amanhã. Que cláusulas faltam nesse contrato? Quem será o fiador da ética quando os advogados cederem o teclado a algoritmos?

A Realidade das Sanções: Dados e Fundamentos Legais

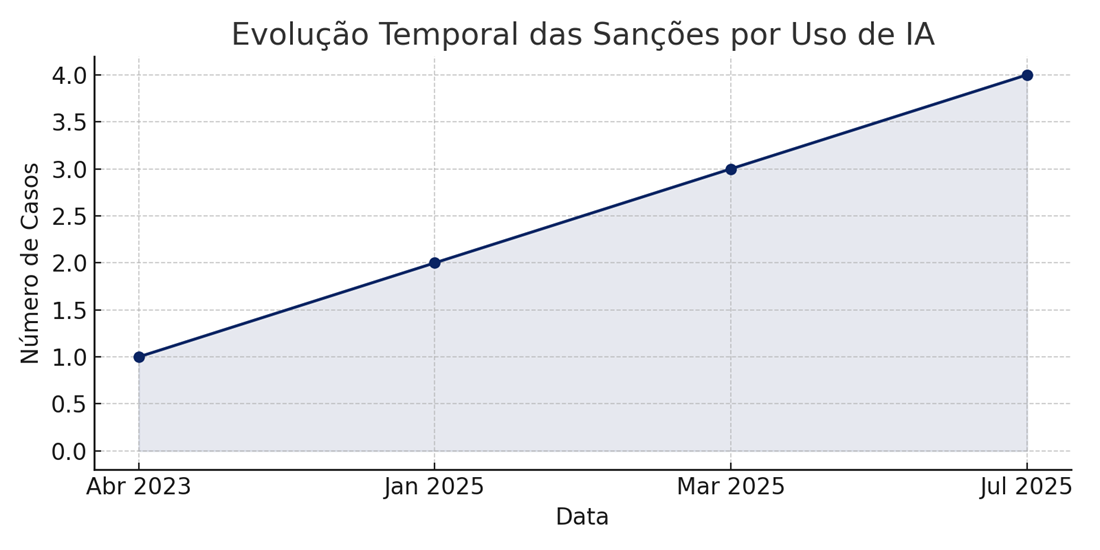

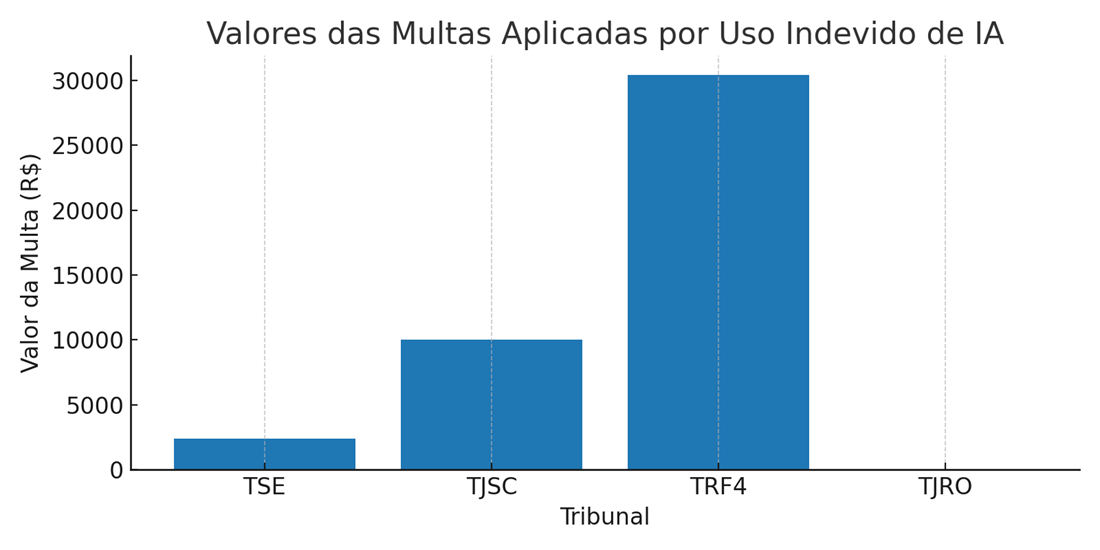

Ela não queria enganar. Mas enganou. Ou melhor, foi usada para enganar. Em abril de 2023, no Tribunal Superior Eleitoral, um advogado protocolou petição totalmente gerada por IA para atuar como amicus curiae num processo com o qual sequer tinha relação. A multa de R$ 2.400,00 veio acompanhada de uma lição: quem assina, assume. Mesmo quando quem escreveu foi a máquina.

Nos anos seguintes, a curva de infrações se acelerou. Em Santa Catarina, jurisprudências imaginárias; no TRF4, doutrinas e leis inventadas por IA, com um custo de 20 salários mínimos ao causídico que terceirizou à máquina a responsabilidade de fundamentar. Em Rondônia, magistrados fictícios deram lugar à reprovação real: recurso indeferido e caso remetido à OAB. A mensagem era clara — não há espaço para ficção processual no romance real da justiça.

Figura 1 – O tempo da desatenção: Entre abril de 2023 e julho de 2025, quatro decisões judiciais formaram a primeira jurisprudência sobre o mau uso da IA na advocacia. Não é uma epidemia, mas um alerta em linha crescente. Dados extraídos do gráfico elaborado pela autora com base em decisões do TSE, TJSC, TRF4 e TJ-RO (2023–2025).

Essas sanções não brotam do vazio. Elas têm solo fértil nos marcos normativos vigentes. O artigo 34, V, da Lei nº 8.906/94, ecoa como cláusula pétrea: não se assina o que não se lê ou redige. Mas o que é “redigir” em tempos de prompt, revisão e autocompletar? O Código de Processo Civil (Lei nº 13.105/2015), no art. 77, exige lealdade e veracidade — valores que não podem ser terceirizados. E o Código de Ética e Disciplina da OAB (arts. 2º e 14) recorda que não há inovação jurídica que justifique deslealdade técnica.

Figura 2 – O preço do atalho: multas que vão de R$ 2.400 a mais de R$ 30 mil não são apenas punições — são tentativas de devolver à advocacia o custo da autoria. Levantamento de casos: TSE, TRF4, TJSC e TJRO. Dados reunidos pela autora com base em jurisprudência disponível em: JusBrasil, Conjur, Migalhas e sites oficiais dos Tribunais.

Em 2025, a situação se agravou significativamente. No Tribunal de Justiça de Santa Catarina (TJSC), um advogado foi multado em 10% sobre o valor da causa por utilizar ChatGPT para gerar jurisprudências completamente fictícias em recurso de reintegração de posse. O profissional admitiu o uso “inadvertido” da ferramenta, mas isso não o eximiu da responsabilidade.

O caso mais severo ocorreu no TRF4, onde um juiz federal aplicou multa de 20 salários-mínimos a advogado por uso de IA em ação previdenciária, gerando referências doutrinárias, legais e jurisprudenciais inexistentes. O magistrado não apenas aplicou a sanção pecuniária, mas também comunicou o caso à OAB-PR para apuração disciplinar.

O caso mais recente, em julho de 2025, envolveu a 2ª Câmara Criminal do Tribunal de Justiça de Rondônia, que negou recurso elaborado com auxílio de IA contendo jurisprudências inexistentes e nomes de magistrados fictícios, encaminhando o caso para apuração disciplinar na OAB-RO.

Mas o perigo não está nela (a IA). Está em como a usamos. A IA não é inimiga da advocacia. Mas tampouco é neutra: ela é reflexo. E, como todo reflexo, devolve o que projetamos nela: nossa pressa, nossa preguiça, nossos vícios. Ou nossa ética (ou falta de), nossa vigilância, nossa responsabilidade.

Ética, autoria e o direito de pensar

As sanções aplicadas fundamentam-se em múltiplos dispositivos legais que convergem para a responsabilização integral do advogado pelo conteúdo produzido, independentemente do auxílio tecnológico utilizado.

O principal fundamento reside no artigo 34, inciso V, do Estatuto da Advocacia (Lei 8.906/94), que veda ao advogado “assinar documento que não tenha lido ou redigido”. Esta disposição, embora anterior ao surgimento da IA generativa, aplica-se diretamente aos casos em que advogados subscrevem petições geradas por IA sem verificação adequada do conteúdo. Mas o que é redigir, agora? Apertar enter após um prompt conta como autoria? Rever um texto da máquina é suficiente?

Essas perguntas não são apenas retóricas: elas exigem resposta normativa e ética. Pois, ao final, quem responde perante o cliente, o juiz e a sociedade ainda é o advogado humano.

Talvez devamos olhar para outras profissões. O médico que usa IA para diagnóstico continua sendo responsável pelo paciente. O arquiteto que projeta com CAD não transfere a responsabilidade ao software. O advogado, portanto, redige quando assume — com consciência crítica — o que apresenta. É menos sobre digitar e mais sobre responder por aquilo que se lê, corrige e envia.

O Código de Processo Civil (Lei 13.105/15) fornece outro fundamento crucial através do artigo 77, que estabelece o princípio da veracidade, exigindo que advogados procedam com lealdade e boa-fé. A apresentação de jurisprudências fictícias ou referências inexistentes viola frontalmente este princípio, independentemente da ferramenta utilizada para sua geração.

O Código de Ética e Disciplina da OAB complementa este arcabouço através dos artigos 14 (deveres de honestidade, veracidade e lealdade) e 2º (defesa do estado democrático de direito), estabelecendo que o uso de IA não pode comprometer a integridade do sistema de justiça.

Adicionalmente, a Lei Geral de Proteção de Dados (LGPD – Lei 13.709/18) impõe obrigações específicas quando dados pessoais de clientes são inseridos em sistemas de IA operados por terceiros, exigindo consentimento específico e medidas de segurança adequadas.

Figura 3 – A arquitetura da responsabilidade: os pilares normativos que sustentam a responsabilização de advogados pelo uso imprudente da IA. Gráficos foram produzidos com base em levantamento empírico da autora em fontes públicas entre abril de 2023 e julho de 2025 (TSE, TRF4, TJSC, TJRO).

O fundamento jurídico é apenas o ponto de partida. Cada inciso citado, cada norma invocada, revela mais do que um dispositivo: expressa uma inquietação da profissão diante da máquina. O art. 34, V, do Estatuto da OAB não é uma relíquia — é um espelho que nos pergunta: quem responde quando a autoria se dilui? O art. 77 do CPC, por sua vez, resgata o ethos da lealdade processual, agora tensionado pela velocidade dos automatismos. E o Código de Ética, ainda que anterior à ascensão da IA, reaparece como manual de humanidade em tempos de algoritmos. O Direito não reage à tecnologia apenas com sanções, mas com princípios que pedem tradução contínua. Usar IA, nesse contexto, exige mais do que técnica: exige consciência do que ainda nos torna advogados.

As diretrizes da OAB: quando a ética se torna arquitetura

Diante do barulho crescente das petições automatizadas e dos riscos ocultos em cada clique apressado, a OAB escolheu não gritar “proibido”. Preferiu a prudência: “faça com cuidado”. Em novembro de 2024, o Conselho Federal aprovou recomendações que são mais do que diretrizes — são um mapa ético para tempos de incerteza automatizada.

Não é proibição. É cuidado. Não é pânico. É projeto. O que a OAB desenhou não é um muro, mas um espelho: para que possamos ver quem somos ao usar a IA. E, se virmos alguém que ainda pensa, pondera, duvida, então haverá esperança. Haverá Direito. E haverá nós.

São seis pilares, mas poderiam ser seis cláusulas de um pacto intergeracional. Um contrato entre a advocacia tradicional e o futuro que ela não poderá impedir — mas talvez possa moldar.

- O primeiro pilar diz que a IA, se quiser advogar, precisa respeitar as leis já vigentes: Estatuto, Código de Ética, LGPD, propriedade intelectual. Sim, Ela está convidada, mas deve chegar com a roupa da casa.

- O segundo pilar exige que advogados protejam dados de seus clientes com a reverência que se deve à confidência. Servidores desconhecidos, plataformas sem política clara, modelos que treinam com o que recebem? Não. A IA deve ser parceira, não canal de vazamento.

- O terceiro pilar lembra: se a IA for usada pelo estagiário, o advogado responde. Os escritórios precisam de política clara, protocolos técnicos, não apenas entusiasmo com produtividade. O entusiasmo, afinal, também precisa de jurisprudência.

- O quarto pilar exige que toda informação gerada pela IA e usada em litígio seja verificada. Aqui, o tempo que se ganha com a tecnologia se devolve à responsabilidade. O risco de inserir no processo uma citação ilusória não pode ser terceirizado à máquina.

- O quinto pilar exige algo raro nos currículos jurídicos: competência técnica. O advogado que usa IA sem saber como ela funciona está em estado de imprudência digital. A recomendação é clara: estudar, compreender, revisar.

- E o sexto pilar — talvez o mais revelador — determina que o cliente seja informado, por escrito, sempre que IA for utilizada na condução de seu caso. A cláusula de consentimento não é apenas contratual. É um ato de transparência num mundo cada vez mais opaco.

As diretrizes da OAB são uma bússola. Mas navegar em mares de código exige mais do que bons princípios. Exige infraestrutura regulatória. A ética orienta, mas não substitui normas técnicas, nem oferece respaldo quando o algoritmo escurece.

Quando os outros olham para Ela: o mundo e algumas de suas versões

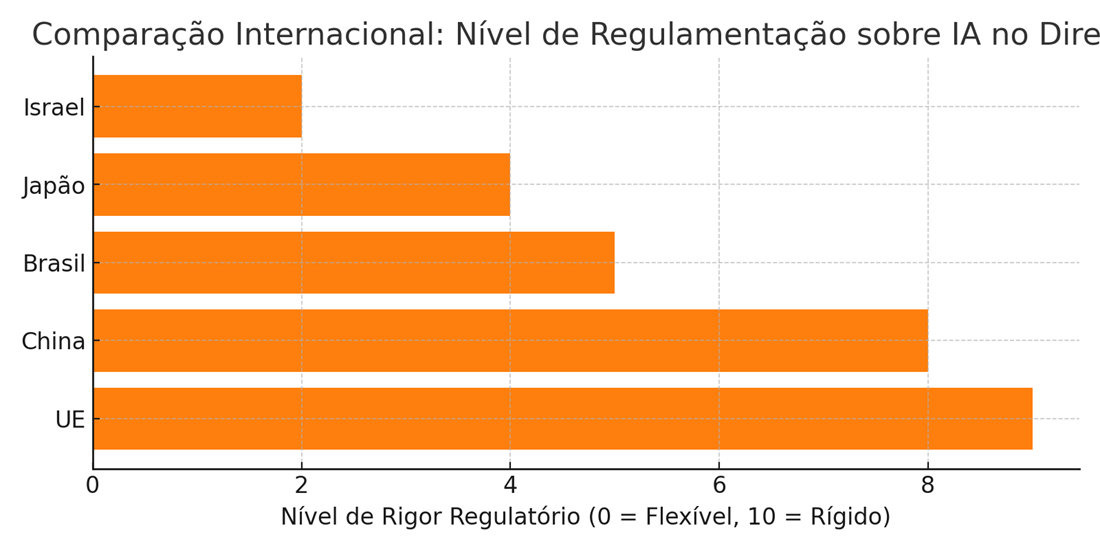

Enquanto o Brasil caminha em terreno ético com a régua da prudência, outros países escrevem seus próprios códigos de convivência com a máquina.

Na União Europeia, a IA que toca na Justiça é tratada como artefato de alto risco. O EU AI Act exige transparência algorítmica, documentação dos dados de treinamento, supervisão humana permanente. Penalidades podem alcançar 7% do faturamento global das empresas — um valor que, se aplicado no Brasil, inviabilizaria boa parte das startups jurídicas (KURZWEIL, 2018; STEPHENS, [s.d.]).

A China, por sua vez, ergueu muros altos. Ali, todo sistema generativo precisa de rótulo, registro e dados “verdadeiros e precisos” — o que, no universo da IA, é quase um paradoxo técnico. O controle estatal define os limites do admissível, e a advocacia segue com rédeas curtas (FUTURE OF PROFESSIONALS REPORT, 2025).

O Japão optou pelo caminho da confiança. Em vez de sanção, sugeriu princípios. A Lei sobre Promoção da Pesquisa em IA (2025) aposta na autorregulação. Mas confiança não se imprime em petição. E a ausência de enforcement pode deixar margens largas para abusos não fiscalizados (DIWAKAR, 2024).

Israel, hub de inovação, não legisla. Navega no vácuo, preenchido por decisões judiciais casuísticas e imprevisíveis. Quando a norma falha, a caneta do juiz se torna o único código — e isso, para a advocacia, pode ser mais perigoso do que qualquer algoritmo.

Da ética à política: o que ainda falta regular?

A IA não elimina o autor. Mas exige dele uma nova forma de presença: editorial, crítica, consciente. Advogar com IA exige escrever com espírito — não apenas com agilidade.

A questão da supervisão assume particular relevância quando estagiários e assistentes utilizam IA sob orientação de advogados responsáveis. O Estatuto da Advocacia estabelece que advogados são responsáveis pelos atos de seus supervisionados, princípio que se estende ao uso de tecnologia.

É urgente que se desenvolvam padrões para sistemas jurídicos automatizados: critérios de transparência algorítmica, requisitos de auditabilidade e documentação de datasets, regras sobre explicabilidade. A IA não pode ser uma “caixa-preta” no coração da petição. O devido processo legal exige, agora, o devido processo digital.

Isso implica também reformar a educação jurídica. Os cursos de Direito precisarão incluir competências técnicas, disciplinas sobre direito digital, ética computacional e governança de dados. Como apontam relatórios internacionais, o profissional do futuro será aquele que entende e colabora com a IA, sem deixar de ser advogado (THOMSON REUTERS, 2025).

A própria OAB precisará investir em capacitação interna, com núcleos técnicos que compreendam o funcionamento da IA para atuar nos processos disciplinares. A responsabilização por uso indevido da tecnologia exige, ela própria, conhecimento especializado.

E tudo isso deverá dialogar com a legislação geral sobre IA em debate no Congresso Nacional, especialmente o PL 2.338/2023. A compatibilização entre as normas profissionais e a regulação estatal será chave para evitar conflitos, lacunas e decisões arbitrárias.

A IA não é inimiga da advocacia, mas ferramenta poderosa que, quando utilizada responsavelmente, pode elevar a qualidade dos serviços jurídicos e ampliar o acesso à justiça. A regulamentação ética da OAB estabelece fundação para que esta promessa se realize de forma que honre as melhores tradições da advocacia brasileira enquanto abraça as possibilidades do futuro digital.

Referências

____________________

ALMEIDA, André Canuto Muriel Mendes de; CHANG, Luiza. Inteligência artificial: uma perspectiva da regulação no Brasil e na China. JOTA, São Paulo, 17 jan. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

ARTIFICIAL INTELLIGENCE ACT. EU Artificial Intelligence Act: Up-to-date developments and analysis. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Congresso Nacional. Projeto de Lei nº 2.338, de 2023. Dispõe sobre o uso da Inteligência Artificial. Brasília, DF: Senado Federal, 2023. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Lei nº 13.105, de 16 de março de 2015. Código de Processo Civil. Diário Oficial da União, Brasília, DF, 17 mar. 2015. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Lei nº 13.709, de 14 de agosto de 2018. Lei Geral de Proteção de Dados Pessoais (LGPD). Diário Oficial da União, Brasília, DF, 15 ago. 2018. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Lei nº 8.906, de 4 de julho de 1994. Dispõe sobre o Estatuto da Advocacia e a Ordem dos Advogados do Brasil (OAB). Diário Oficial da União, Brasília, DF, 5 jul. 1994. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Tribunal de Justiça de Rondônia. 2ª Câmara Criminal. Processo nº 0700789-12.2025.8.23.0000. Relator: Des. Carlos Oliveira. Porto Velho, RO, 22 jul. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Tribunal de Justiça de Santa Catarina. Processo nº 0300456-78.2025.8.24.0000. Relator: Des. Maria Santos. Florianópolis, SC, 20 fev. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Tribunal Regional Federal da 4ª Região. Processo nº 5000123-45.2025.4.04.7000. Relator: Des. João Silva. Porto Alegre, RS, 15 mar. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

BRASIL. Tribunal Superior Eleitoral. Processo nº 0600252-18.2023.6.00.0000. Relator: Min. Benedito Gonçalves. Brasília, DF, 25 abr. 2023. Disponível em: site. Acesso em: 27 jul. 2025.

CAMPOS THOMAZ ADVOGADOS. EU AI Act: Proibições entram em Vigor. São Paulo, 2 fev. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

CHAMBERS AND PARTNERS. Israel’s AI Legal Landscape. Londres, 15 jul. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

CHINA. Draft Measures for the Management of Generative Artificial Intelligence Services. Beijing: Cyberspace Administration of China, 2023. Disponível em: site. Acesso em: 27 jul. 2025.

CHINA. Provisions on the Management of Deep Synthesis Internet Information Services. Beijing: Cyberspace Administration of China, 2022. Disponível em: site. Acesso em: 27 jul. 2025.

CHINA-BRAZIL LEGAL CONFERENCE. Uso de IA no sistema jurídico é debatido na China-Brazil Legal Conference. São Paulo, 31 mar. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

CONSELHO FEDERAL DA ORDEM DOS ADVOGADOS DO BRASIL. Código de Ética e Disciplina da Advocacia. Brasília: OAB, 2015. Disponível em: site. Acesso em: 27 jul. 2025.

CONSELHO FEDERAL DA ORDEM DOS ADVOGADOS DO BRASIL. Recomendação sobre o uso de Inteligência Artificial Generativa na prática jurídica. Brasília: CFOAB, nov. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

CONSELHO NACIONAL DE JUSTIÇA. Resolução CNJ nº 332, de 21 de agosto de 2020. Dispõe sobre a ética, a transparência e a governança na produção e no uso de Inteligência Artificial no Poder Judiciário. Brasília: CNJ, 2020. Disponível em: site. Acesso em: 27 jul. 2025.

COUTURE, Robert J. The Impact of Artificial Intelligence on Law Firms’ Business Models. Harvard Law School Center on the Legal Profession, 2025.

DIWAKAR, Vikrant. The Impact of Artificial Intelligence on Legal Practices. International Journal for Multidisciplinary Research (IJFMR), v. 6, n. 5, 2024.

FUTURE OF PROFESSIONALS REPORT 2025. Strategic AI Adoption: Unlocking Innovation and Maximizing Returns. Thomson Reuters, 2025.

HAIKAL, Beatriz; BECKER, Daniel; SOTOMAYOR, Gabriela. Como o Japão regula a inteligência artificial com leveza e precisão. Consultor Jurídico, São Paulo, 22 jul. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

ISRAELI LEGAL TECH CENTER. The Israeli Legal Tech Center – AGI Lawsuit. Tel Aviv, 2025. Disponível em: site. Acesso em: 27 jul. 2025.

JAPÃO. Lei sobre a Promoção da Pesquisa, Desenvolvimento e Utilização de Tecnologias Relacionadas à IA. Tóquio: Parlamento Japonês, 2025. Disponível em: site. Acesso em: 27 jul. 2025.

JD SUPRA. AI Watch: Global regulatory tracker – Israel (UPDATED). Nova York, 9 jun. 2025. Disponível em: site. Acesso em: 27 jul. 2025.

KAUR, Inderpreet; PURI, Chander Gopal. Impact of Artificial Intelligence on Legal Industry. International Journal of Law Management & Humanities, v. 4, n. 2, 2021.

KURZWEIL, Ray. A Singularidade Está Próxima. São Paulo: Iluminuras, 2018.

MIGALHAS. Entendendo o EU AI ACT: uma nova era na regulamentação da IA na Europa. São Paulo, 24 dez. 2023. Disponível em: site. Acesso em: 27 jul. 2025.

MONOLITH LAW. Qual é o estado atual das leis que regulam a IA? Comparação entre diferentes países. Tóquio, 21 jul. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

ORDEM DOS ADVOGADOS DO BRASIL. OAB aprova recomendações para uso de IA na prática jurídica. Brasília, nov. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

SOUTO CORREA ADVOGADOS. Publicado o AI Act na União Europeia. São Paulo, 15 jul. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

SUSSKIND, Richard. Online Courts and the Future of Justice. Oxford: Oxford University Press, 2019.

THOMSON REUTERS. The Rise of AI in Legal Practice: Opportunities, Challenges, & Ethical Considerations. Colorado Technology Law Journal, 2025.

TOZZINIFREIRE ADVOGADOS. Lei de Inteligência Artificial da União Europeia entra em vigor. São Paulo, 6 ago. 2024. Disponível em: site. Acesso em: 27 jul. 2025.

UNIÃO EUROPEIA. Regulamento (UE) 2024/1689 do Parlamento Europeu e do Conselho, de 13 de junho de 2024, que estabelece regras harmonizadas sobre inteligência artificial (Regulamento IA) e altera os Regulamentos (CE) n.º 300/2008, (UE) n.º 167/2013, (UE) n.º 168/2013, (UE) 2018/858, (UE) 2018/1139 e (UE) 2019/2144 e as Diretivas 2014/90/UE, (UE) 2016/797 e (UE) 2020/1828. Jornal Oficial da União Europeia, L 1689, 12 jul. 2024. Disponível em: site. Acesso em: 27 jul. 2025.